Recoger una lata de gaseosa puede ser una tarea simple para los humanos, pero sin duda es una tarea compleja para los robots. Estos tienen que localizar el objeto, deducir su forma, determinar la cantidad correcta de fuerza para usar y agarrar el objeto sin dejarlo caer. Estas son cosas que nuestro cerebro hace de manera intuitiva y el desafío de la ciencia robótica es poder hacer que los robots puedan hacerlo igual que nosotros. Pues bien, parece que lo han logrado.

Habilidades de detección inteligentes para robots

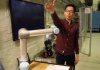

Un equipo de científicos informáticos e ingenieros de materiales de la Universidad Nacional de Singapur (NUS) ha demostrado recientemente un enfoque emocionante para hacer que los robots sean más inteligentes. Desarrollaron un sistema cerebral integrado sensorial que imita las redes neuronales biológicas, que pueden ejecutarse en un procesador neuromórfico eficiente en energía, como el chip Loihi de Intel. Este novedoso sistema integra sensores de visión y piel artificial, equipando a los robots con la capacidad de sacar conclusiones precisas sobre los objetos que están agarrando en función de los datos capturados por los sensores de visión y tacto en tiempo real.

El Profesor Asistente Benjamin Tee del Departamento de Ciencia e Ingeniería de Materiales de NUS. Co-dirige este proyecto con el profesor asistente Harold Soh del Departamento de Ciencias de la Computación de la NUS School of Computing y en una reciente conferencia de robótica dijo:

“El campo de la manipulación robótica ha progresado mucho en los últimos años. Sin embargo, fusionar tanto la visión como la información táctil para proporcionar una respuesta altamente precisa en milisegundos sigue siendo un desafío tecnológico. Nuestro trabajo reciente combina nuestras pieles electrónicas ultrarrápidas y nuestros sistemas nerviosos con las últimas innovaciones en detección de visión e IA para robots para que puedan volverse más inteligentes e intuitivas en las interacciones físicas”.

Este descubrimiento podría significar el desarrollo de un sentido táctil humano para robots. El permitir un sentido del tacto humano en la robótica podría mejorar significativamente la funcionalidad actual e incluso conducir a nuevos usos. Por ejemplo, en el piso de una fábrica, los brazos robóticos provistos de máscaras electrónicas podrían adaptarse fácilmente a diferentes elementos, utilizando sensores táctiles para identificar y agarrar objetos desconocidos con la cantidad adecuada de presión para evitar resbalones.

En el nuevo sistema robótico, el equipo de NUS aplicó una piel artificial avanzada conocida como Asynchronous Coded Electronic Skin (ACES) desarrollada por Asst Prof Tee y su equipo en 2019. Este nuevo sensor detecta toques más de 1,000 veces más rápido que el sistema nervioso sensorial humano. También puede identificar la forma, textura y dureza de los objetos 10 veces más rápido que un abrir y cerrar de ojos.

“Hacer un sensor de piel artificial ultrarrápido resuelve aproximadamente la mitad del rompecabezas de hacer que los robots sean más inteligentes. También necesitan un cerebro artificial que finalmente pueda lograr la percepción y el aprendizaje como otra pieza crítica en el rompecabezas”, agregó Asst Prof Tee, quien también forma parte del Instituto NUS para la Innovación y Tecnología en Salud.

Para abrir nuevos caminos en la percepción robótica, el equipo de NUS exploró la tecnología neuromórfica, un área de computación que emula la estructura neural y el funcionamiento del cerebro humano, para procesar datos sensoriales de la piel artificial. Como Asst Prof Tee y Asst Prof Soh son miembros de la Intel Neuromorphic Research Community (INRC), fue una elección natural utilizar el chip de investigación neuromórfico Loihi de Intel para su nuevo sistema robótico.

En sus experimentos iniciales, los investigadores colocaron una mano robótica con la piel artificial, y la usaron para leer braille, pasando los datos táctiles a Loihi a través de la nube para convertir los micros golpes que siente la mano en un significado semántico. Loihi logró más del 92 por ciento de precisión en la clasificación de las letras Braille, mientras usa 20 veces menos energía que un microprocesador normal.

Todo esto nos pone sin duda un paso más cerca del desarrollo de un cerebro humano para robots. Un hecho que en cierta forma emociona pero también nos asusta.