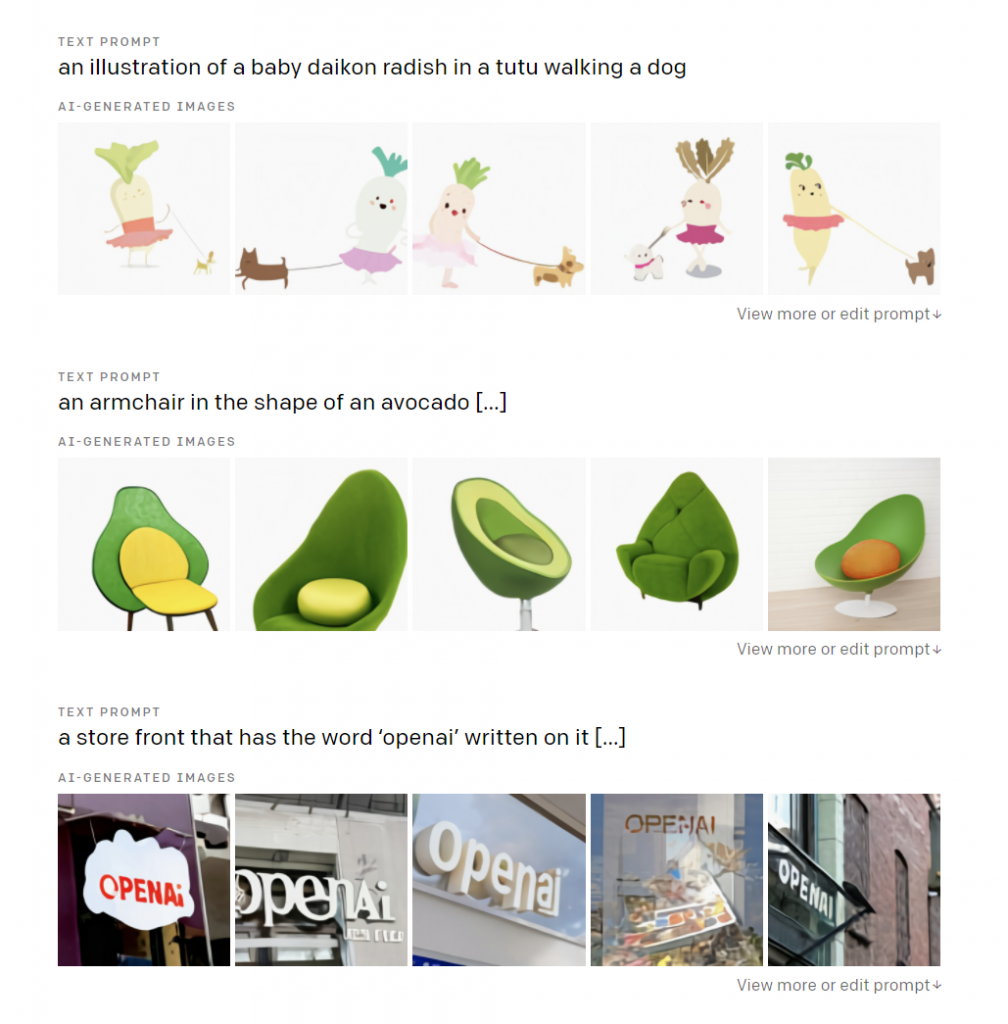

Una red neuronal de generación de imagen llamada DALL · E. creada por OpenAI tiene la capacidad de generar imágenes a partir de descripciones de texto. Es una versión de 12 mil millones de parámetros de GPT-3.

“Descubrimos que DALL · E es capaz de crear imágenes plausibles para una gran variedad de oraciones que exploran la estructura compositiva del lenguaje”, explica OpenAI.

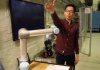

La IA puede generar dibujos, objetos e incluso fotos manipuladas del mundo real. Estas son algunas de las imágenes de ejemplo que mostró OpenAI, creadas por DALL · E.

Tal y como sucedió con el generador de texto GPT-3 de OpenAI, el nuevo sistema de imágenes también puede ser bastante controvertido. Con GPT-3, se dijo que podría promover la generación de noticias falsas de forma automatizada si caía en las manos equivocadas. Ahora, el peligro podría ser la manipulación de imágenes.

Las personas son cada vez más conscientes de las noticias falsas y no creen todo lo que leen, especialmente de fuentes desconocidas sin buenos antecedentes. Sin embargo, como humanos, nos fiamos mucho de nuestros ojos. Cualquiera puede convencernos de un hecho si nos muestra una imagen.

Pero al igual que con GPT-3, OpenAI argumentó diciendo que al presentar la tecnología de la manera más responsable posible, ayuda a crear conciencia e impulsa la investigación sobre cómo se pueden abordar las implicaciones antes de que tales redes neuronales sean inevitablemente creadas y utilizadas de forma inescrupulosa.

“Reconocemos que el trabajo que involucra modelos generativos tiene el potencial de generar impactos sociales amplios y significativos”, dijo OpenAI.

“En el futuro, planeamos analizar cómo modelos como DALL · E se relacionan con problemas sociales como el impacto económico en ciertos procesos de trabajo y profesiones, el potencial de sesgo en los resultados del modelo y los desafíos éticos a largo plazo que implica esta tecnología”.

Con los avances tecnológicos, ciertamente siempre hay riesgos, pero los asumimos cuando consideramos que los beneficios superan estos riesgos. Según el pensamiento de los creadores de OpenAI, si los “buenos” no lo construyen, podemos estar seguro de que los malos sí lo harán y ellos están dispuestos a dar los peores usos a la tecnología.