El Proyecto Euphonia planea mejorar la inclusión del reconocimiento de voz para las personas con discapacidades que afectan su habla. Los sistemas de reconocimiento de voz actuales no reconocen la voz de las personas que padecen enfermedades como la esclerosis lateral amiotrófica (ELA), que ocasionan problemas en el habla. Así que Google se ha propuesto resolver el problema con el Proyecto Euphonia.

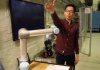

En el siguiente video puedes ver como Dimitri Kanevsky, un investigador de Google que tiene problemas con el habla, no logra ser entendido por un asistente de voz. Sin embargo, un sistema llamado Parrotron al final puede hacer sus palabras más entendibles para el asistente de Google.

Esto fue lo que dijeron los investigadores acerca del contexto en el que se pensó en Euphonia.

“Los sistemas ASR [reconocimiento automático de voz] a menudo se entrenan a partir del habla ‘típica’, lo que significa que los grupos subrepresentados, como aquellos con impedimentos del habla o acentos intensos, no experimentan el mismo grado de utilidad.

… Los modelos actuales de ASR de última generación pueden producir altas tasas de error de palabras (WER) para los hablantes con una discapacidad auditiva moderada de ALS, lo que impide efectivamente el acceso a tecnologías dependientes de ASR”.

Esta problemática impide al asistente de voz incluso entender los acentos muy marcados. Los investigadores entrenaron la nueva IA durante decenas de horas con la ayuda de personas con ELA. El prototipo aún está en desarrollo, teniendo en cuenta que cada persona con ELA es única y la enfermedad es progresiva, afectando el habla también en ese sentido.

Sin embargo, mediante el entrenamiento, Google pudo reducir su tasa de error de palabras al usar un modelo de reconocimiento de voz de referencia y experimentar con algunos ajustes. Aunque el método mejoró sustancialmente el reconocimiento, los investigadores se toparon con dos problemas relacionados con el fonema:

- El fonema no se reconoce y, por lo tanto, la palabra junto con él.

- El modelo tiene que adivinar a qué fonema se refería el hablante.

No obstante, en tanto al segundo problema, se cree que la IA puede resolverlo teniendo en cuenta el resto de la oración. Por ejemplo, si la IA escucha “cómo caminar la ansiedad”, probablemente determine que el usuario quiso decir “cómo calmar la ansiedad”.